Mistral Le Chat im Praxistest – kann es ChatGPT und Claude ersetzen?

Mistral will die europäische Antwort auf ChatGPT und Claude sein. Ein KI-Chatbot aus Paris, kostenlos nutzbar, ohne Werbung, mit Thinking-Modus. Klingt gut auf dem Papier – aber reicht das, was Le Chat im Alltag abliefert? Ich habe alle drei KI-Chatbots mit identischen Aufgaben gefüttert: Code schreiben, im Web recherchieren, einen Blogartikel produzieren. Kein Benchmark-Vergleich, sondern ein Praxistest so, wie du die Tools tatsächlich nutzen würdest.

Die getesteten Modelle: Le Chat mit Thinking-Modus – ein Feature, bei dem die KI vor der Antwort nachdenkt. Dahinter steckt Mistral Large 2, wobei man das Modell nicht selbst auswählen kann. Dazu GPT 5.4 mit Thinking Low und Haiku 4.5 ohne erweitertes Denken. Das Ergebnis hat mich überrascht – allerdings nicht so, wie Mistral es sich wünschen würde.

So haben wir getestet

Kein Benchmark, keine Herstellerangaben, kein Datenblatt-Vergleich. Ich habe Le Chat, ChatGPT und Claude denselben Prompt gegeben – über die ganz normale Chat-Oberfläche, so wie jeder Nutzer es tun würde. Keine API, keine Sonderbehandlung, keine Tricks. Der Grund: Benchmarks messen, was ein Modell unter Laborbedingungen kann. Mich interessiert, was es auf meinem Bildschirm liefert.

|

Modell |

Anbieter |

Einstellung |

Chat-Oberfläche |

|---|---|---|---|

|

Le Chat (Mistral Large 2) |

Mistral AI |

Thinking aktiviert |

chat.mistral.ai |

|

GPT 5.4 |

OpenAI |

Thinking Low |

chatgpt.com |

|

Haiku 4.5 |

Anthropic |

Ohne erweitertes Denken |

claude.ai |

Eine Sache ist mir bei Le Chat sofort aufgefallen: Welches Modell gerade läuft, steht nirgends. Auf Nachfrage antwortet der Bot nur, er sei "Le Chat, entwickelt von Mistral AI". Erst nach mehrmaligem Nachhaken kam raus: Mistral Large 2. Bei ChatGPT und Claude wähle ich das Modell selbst – bei Mistral muss ich dem Anbieter vertrauen.

Zwei Aufgaben, identischer Prompt für alle drei: eine HTML-Webseite bauen und einen Blogartikel auf Basis einer Web-Recherche schreiben. Damit decke ich die zwei häufigsten KI-Anwendungsfälle ab – Coding und Content.

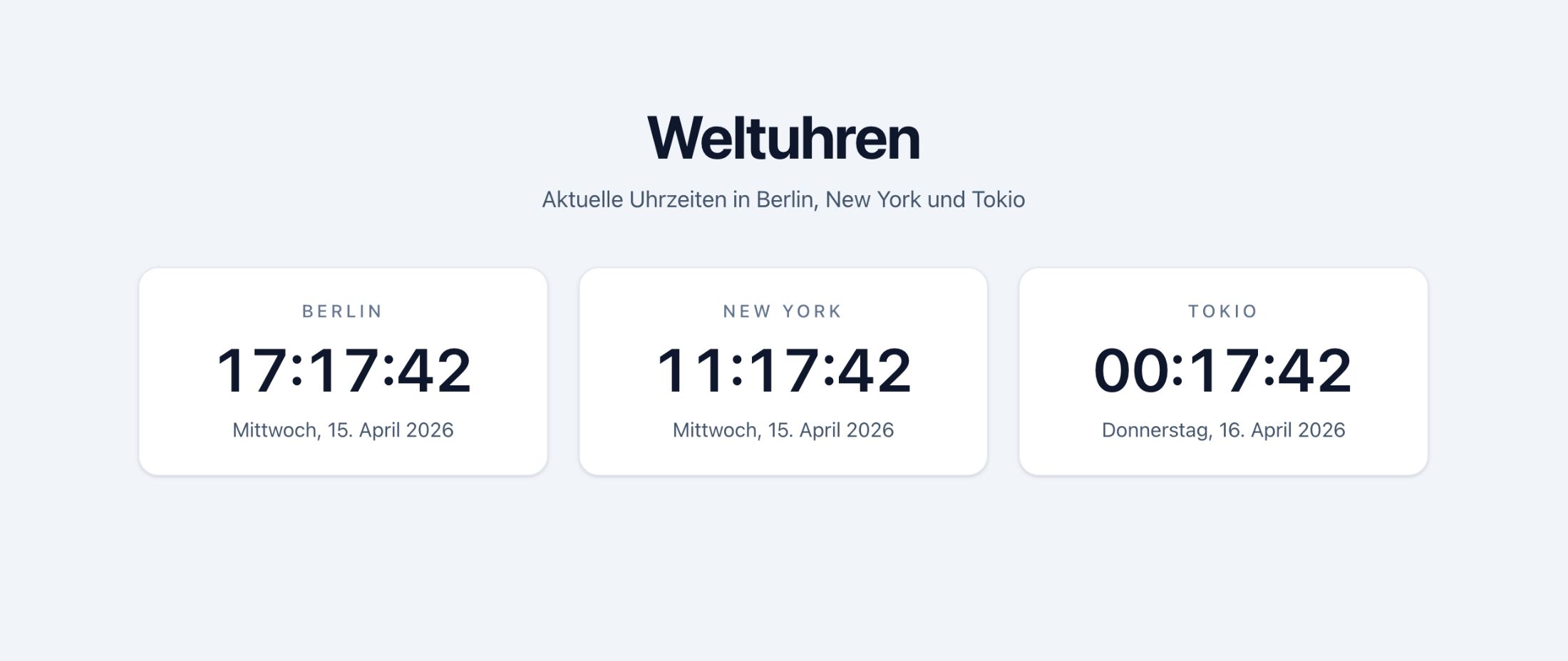

Test 1 – Eine einfache Webseite erstellen

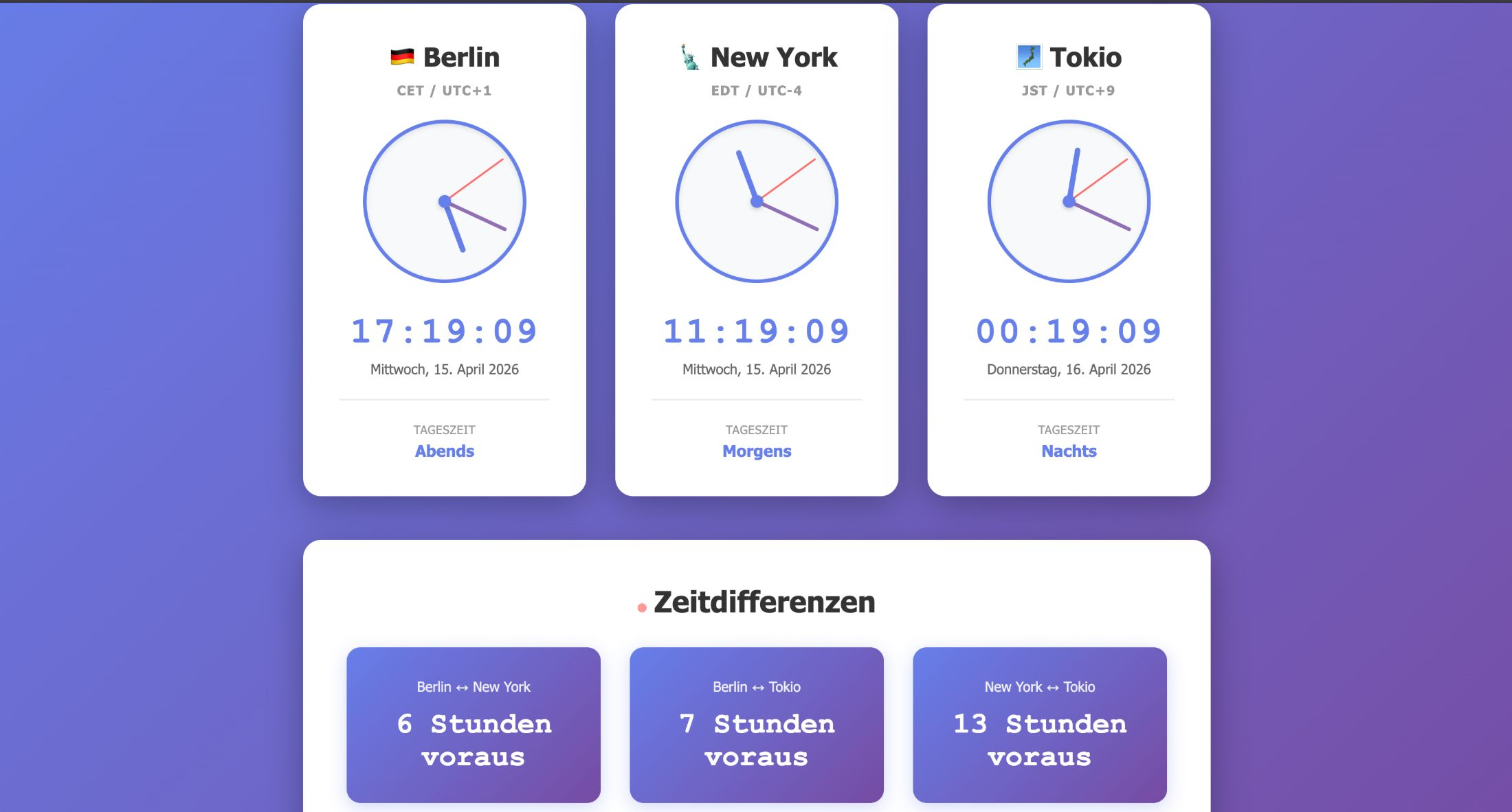

Der Prompt war bewusst simpel: Eine HTML-Seite mit Uhrzeiten für Berlin, New York und Tokyo – live aktualisiert, sauber gestylt. Kein Framework, keine Datenbank – HTML, CSS, ein bisschen JavaScript und sauberes Zeitzonen-Handling. Die Art von Aufgabe, die jeder Einsteiger irgendwann an eine KI stellt. Und die Art von Aufgabe, bei der ein Modell mit Thinking-Modus nicht ins Schwitzen kommen sollte.

Le Chat – drei Anläufe nötig

Im ersten Versuch zeigte Le Chat die Berliner Uhrzeit als "Invalid" an. Die Zeitzonen-Zuordnung war schlicht fehlgeschlagen – eine Weltuhr, die die Heimatstadt nicht kennt. New York und Tokyo liefen, Berlin nicht. Versuch zwei lief technisch, aber alle drei Zeiten waren um zwei Stunden verschoben: 18 Uhr statt 16 Uhr in Berlin. Ein klassischer Offset-Fehler, der zeigt, dass das Modell die Zeitzonen-Logik nicht sauber verarbeitet hat – obwohl der Thinking-Modus genau solche Fehler verhindern soll. Erst der dritte Anlauf brachte korrekte Uhrzeiten – allerdings in einem Design, das nach 2005 aussah. Drei Versuche für eine Aufgabe, die ein Anfänger mit Stack Overflow in 20 Minuten löst. Und das mit aktiviertem Thinking-Modus.

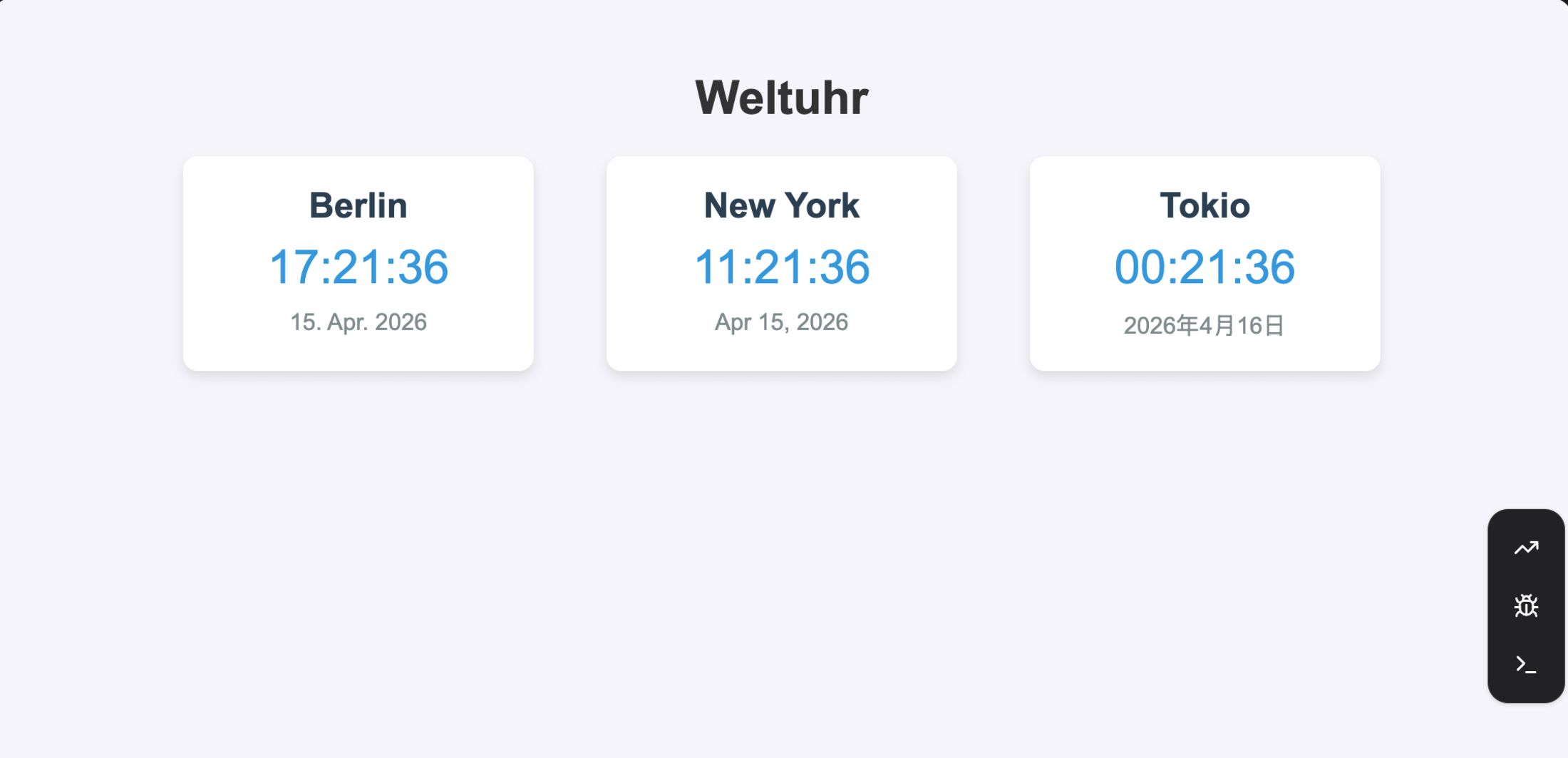

GPT 5.4 – funktional nach dem zweiten Versuch

GPT 5.4 scheiterte im ersten Versuch an sich selbst: Der generierte Code nutzte React-Syntax, die ohne Build-Umgebung nicht lief. Reines HTML war gefragt, geliefert wurde ein Framework-Fragment. Das ist ein typisches Problem – GPT optimiert auf das, was in Coding-Trainings häufig vorkommt, nicht auf das, was der Nutzer tatsächlich braucht.

Im zweiten Anlauf funktionierte die Seite – Uhrzeiten korrekt, Zeitzonen sauber. Das Design allerdings war kaum mehr als schwarzer Text auf weißem Grund.

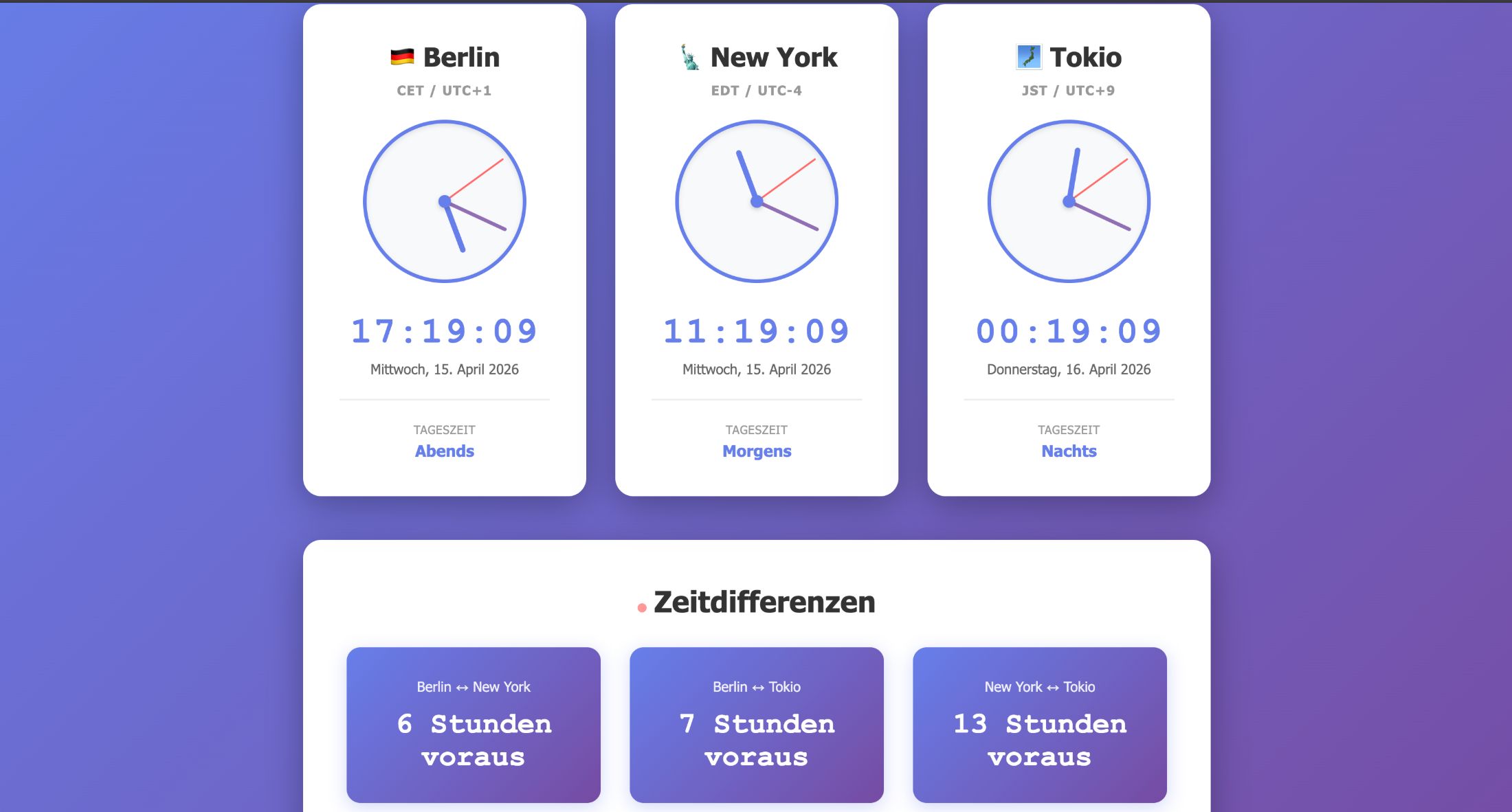

Haiku 4.5 – erster Versuch, bestes Ergebnis

Haiku hat die Aufgabe beim ersten Versuch gelöst. Kein Nachsteuern, kein Korrigieren, kein zweiter Prompt. Die Uhrzeiten stimmten, das Layout war aufgeräumt mit farblich getrennten Karten für jede Stadt, und Haiku hatte eigenständig die Zeitdifferenz zwischen den Städten eingebaut – ein Feature, das niemand verlangt hatte, aber sofort nützlich war. Das Design war mit Abstand das ansprechendste der drei Ergebnisse.

Die Pointe: Haiku 4.5 ist Anthropics kleinstes und günstigstes Modell. Kein Opus, kein Sonnet – das Einstiegsmodell. Während Mistral mit aktiviertem Thinking-Modus drei Anläufe brauchte, hat Haiku ohne erweitertes Denken beim ersten Mal das beste Ergebnis geliefert. Das wirft Fragen auf: Wie viel bringt der Thinking-Modus wirklich, wenn ein kleineres Modell ohne ihn besser abschneidet?

Test 2 – Recherche und Texterstellung

Die zweite Aufgabe war anspruchsvoller: Recherchiere das letzte Google Core Update vom März 2026 und schreib daraus einen Blogartikel. Das testet zwei Dinge gleichzeitig – kann das Modell im Web aktuelle Informationen finden, und kann es daraus einen lesbaren Text bauen?

Websuche war bei allen drei aktiviert – gleiche Ausgangslage, gleicher Prompt. Bewertet habe ich Recherchetiefe, Quellenqualität, Textstruktur und ob der fertige Artikel tatsächlich brauchbar wäre. Nicht als akademische Übung, sondern so, wie ich es im Redaktionsalltag einsetzen würde.

Recherche – wer findet mehr?

Haiku hat am tiefsten gegraben. Das Modell hat drei Updates in fünf Wochen erkannt – Discover, Spam und das Core Update selbst –, den Semrush-Sensor bei 9,4 von 10 Punkten eingeordnet und eine HubSpot-Case-Study als konkretes Beispiel für Sichtbarkeitsverluste zitiert. Dazu vier destillierte Trends und die Zahl, dass 55 % der analysierten Websites betroffen waren. Das war keine Stichwort-Sammlung, das war eine Recherche, mit der ich hätte arbeiten können.

Le Chat lieferte die Kerndaten korrekt und hatte mit der SISTRIX-Analyse sogar deutsche Beispiele parat – kuechengoetter.de mit minus 29 % Sichtbarkeit, Glenn Gabe als namentlich zitierten SEO-Experten. Für den deutschsprachigen Markt nützlicher als Haikus internationale Perspektive. Allerdings tauchten Zahlen auf, die ich keiner Quelle zuordnen konnte: 52 % E-Commerce-Anteil bei den Verlierern, 23 % durchschnittlicher Sichtbarkeitsverlust. Klingen plausibel, aber ich konnte sie nirgends verifizieren. Das ist ein Problem – wenn eine KI Zahlen liefert, die sich nicht prüfen lassen, schwindet das Vertrauen in alle anderen Daten gleich mit.

GPT 5.4 hat am wenigsten geliefert. Vier Punkte auf Meta-Ebene, keine konkreten Daten, keine Fallbeispiele, keine Zahlen. Keine betroffenen Websites, kein Sensor-Score, keine Timeline. Wer damit einen Blogartikel schreiben will, fängt im Grunde bei null an. Für OpenAIs stärkstes Angebot ist das enttäuschend dünn.

Texterstellung – wer schreibt den besseren Artikel?

Haiku lieferte den umfassendsten Text: chronologischer Aufbau, vier Trend-Analysen mit konkreten Daten, FAQ und sogar SEO-Elemente wie Title und Meta-Description. Ein Artikel, den ich mit leichtem Feinschliff hätte veröffentlichen können – Struktur stand, Fakten stimmten, die Argumentation war schlüssig. Einziger Makel: Haiku siezt den Leser. Für PHM.de müsste ich die Ansprache anpassen – kein Drama, aber ein Extra-Schritt, den Le Chat mir erspart hat.

Le Chat hat korrekt geduzt und eine brauchbare Struktur mit fünf Handlungsempfehlungen gebaut – "Content-Audit durchführen", "E-E-A-T stärken", solche Sachen. Handwerklich solide. Der Text liest sich allerdings wie ein Template-Blogpost: ordentlich aufgebaut, aber austauschbar. Kein Absatz, bei dem ich gedacht hätte: Das ist ein eigenständiger Gedanke. Und die fragwürdigen Zahlen aus der Recherche wurden eins zu eins übernommen – Le Chat hat seine eigene Schwäche nicht korrigiert, sondern sie in den fertigen Text einzementiert.

GPT 5.4 siezt ebenfalls, schreibt extrem vorsichtig und klebt an jeden Absatz eine Quellenklammer. Journalistisch korrekt, inhaltlich dünn. Keine eigene Einordnung, keine Meinung, kein Standpunkt – ein Text, der sich liest, als hätte ihn jemand geschrieben, der auf keinen Fall anecken will. Wenn ich einen GPT-Text als Grundlage für einen Artikel nehmen wollte, müsste ich mehr umschreiben als bei den anderen beiden. Das soll ausgerechnet das teuerste Modell im Test sein?

Mein Ranking auch hier: Haiku auf Platz eins, Le Chat auf zwei, GPT auf drei. Beide Tests, dasselbe Ergebnis. Und nochmal zur Einordnung: Haiku ist das kleinste Claude-Modell, GPT 5.4 das stärkste Modell von OpenAI.

Preis-Leistung – was kostet wie viel?

Le Chat hat das großzügigste Gratis-Angebot der drei. Und das ist kein Detail am Rand – für Gelegenheitsnutzer ist es der entscheidende Faktor.

|

|

Le Chat (Mistral) |

Claude (Anthropic) |

ChatGPT (OpenAI) |

|---|---|---|---|

|

Kostenlos |

~25 Nachrichten/Tag |

~10–20 Nachrichten pro 5-Stunden-Fenster |

~10 Nachrichten/5h mit GPT-5, dann Mini-Fallback |

|

Einsteiger-Preis |

Pro: 14,99 $/Monat |

Pro: 20 $/Monat |

Plus: 20 $/Monat, Go: 8 $/Monat |

|

Limit im Abo |

~150 Nachrichten (Soft-Cap) |

~45 Nachrichten/5h |

Deutlich höher als Free |

|

Besonderheiten |

Student-Rabatt: 5,99 $ |

Skills, Cowork-Modus inklusive |

Werbung im Free-Tier seit Feb 2026 |

25 Nachrichten pro Tag ohne Anmeldestress, inklusive Websuche und Bildgenerierung – das ist deutlich mehr als ChatGPT und Claude im Free-Tier bieten. ChatGPT beschränkt auf rund zehn Nachrichten pro Fünf-Stunden-Fenster und schaltet danach auf das schwächere Mini-Modell um. Claude liegt mit zehn bis 20 Nachrichten pro Fenster ähnlich knapp.

Dazu kommt: Keine Werbung. ChatGPT zeigt seit Februar 2026 Anzeigen in der kostenlosen Version. Bei Mistral scrollst du nicht an Sponsored Content vorbei, bevor du deine Antwort liest.

Beim Abo dreht sich das Bild. Claudes Pro-Plan für 20 Dollar bringt Skills und den Cowork-Modus mit – Werkzeuge, die im Arbeitsalltag echten Unterschied machen. Wer regelmäßig Texte schreibt, Code generiert oder Daten aufbereitet, merkt den Vorteil nach einer Woche. Le Chats Pro-Plan? Fünf Dollar günstiger, aber das Ökosystem dahinter ist dünner. Den Student-Rabatt auf 5,99 Dollar finde ich stark – für Studierende ist Le Chat Pro praktisch geschenkt.

ChatGPT Go für 8 Dollar im Monat klingt nach einem guten Einstieg, bietet aber weniger als Le Chats Free-Tier. Wer sparen will und trotzdem brauchbare Ergebnisse erwartet, fährt mit Le Chat kostenlos besser als mit dem günstigsten ChatGPT-Abo.

OpenAI hat am 9. April 2026 einen neuen Pro-Tarif für 100 Dollar im Monat eingeführt. Das ist die direkte Antwort auf Claudes Max-Plan und zielt auf Power-User, die das Maximum aus GPT-5 herausholen wollen. Für die meisten Nutzer irrelevant, aber es zeigt, wohin der Markt driftet: Premium-Angebote jenseits der 20-Dollar-Klasse.

Tools und Skills – der unterschätzte Vorteil

Modellqualität ist das eine. Was du mit dem Modell tatsächlich anstellen kannst, ist etwas anderes. Und hier trennt sich das Feld deutlicher als bei jedem Benchmark.

Le Chat bringt Canvas, Websuche und Bildgenerierung mit – für eine einzelne Frage oder eine schnelle Recherche reicht das. Aber sobald du wiederkehrende Aufgaben hast – jeden Montag denselben Report, jede Woche eine Zusammenfassung, regelmäßig Code-Reviews –, fehlen die Werkzeuge. Keine Automatisierungen, keine vorgefertigten Abläufe, kein Ökosystem. Le Chat ist ein guter Gesprächspartner, aber kein Arbeitsgerät.

Claude hat mit Skills einen Ansatz, der im Arbeitsalltag den größten Unterschied macht. Skills sind vorgefertigte Workflows für spezifische Aufgaben – Dokumente erstellen, Daten analysieren, Code-Projekte strukturieren, Recherchen automatisiert durchführen. Dazu kommen der Cowork-Modus für mehrstufige Aufgaben und Projects für die Kontext-Organisation. In der Praxis heißt das: Ich sage Claude, was ich brauche, und der Workflow läuft. Bei Le Chat müsste ich jeden Schritt einzeln anstoßen.

ChatGPT hat Custom GPTs und seit Kurzem den Codex-Agenten, beides ab dem Plus-Plan. Custom GPTs sind im Grunde kleine Spezial-Chatbots, die andere Nutzer erstellt haben – nützlich, aber kein Ersatz für echte Workflows. Skills und tiefere Automatisierung? Nur für Enterprise- und Business-Kunden. Selbst wer 200 Dollar im Monat für den Pro-Plan zahlt, bekommt keinen Zugang zu den mächtigsten Werkzeugen. Ich finde das absurd – gerade Power-User, die bereit sind so viel zu zahlen, werden bei den Tools ausgebremst.

Meine Erfahrung nach Monaten mit allen drei: Für tägliches Arbeiten machen die Tools den Ausschlag. Das beste Modell bringt wenig, wenn du jeden Arbeitsschritt manuell anstoßen musst.

Kann Mistral ChatGPT oder Claude ersetzen?

Kurze Antwort: Kommt drauf an, wofür. Lange Antwort: Für die meisten Leute nein.

Wer Le Chat als kostenloses Recherche-Tool für den Alltag nutzen will – eine Frage hier, eine Zusammenfassung da –, bekommt ein brauchbares Angebot. Großzügiges Tageslimit, Websuche dabei, keine Werbung. Für eine schnelle Einordnung zwischendurch reicht das. Wer bisher ChatGPT Free genutzt hat und von den Anzeigen genervt ist, findet in Le Chat eine saubere Alternative ohne Sponsored Content.

Für tägliches Arbeiten fehlt Mistral zu viel. Die Testergebnisse sprechen eine klare Sprache: drei Versuche für eine simple Webseite, fragwürdige Zahlen in der Recherche, kein Skill-Ökosystem. Le Chat ist ein Chat – nicht mehr. Wer KI professionell nutzt, braucht aber mehr als eine Texteingabe und eine Antwort. Workflows, Kontext-Management, Automatisierungen – das sind die Dinge, die aus einem Chatbot ein Arbeitswerkzeug machen. Und die fehlen bei Mistral.

GPT 5.4 mit kurzem Thinking hat mich in diesem Test nicht überzeugt. In beiden Aufgaben lag es nur knapp vor Mistral – und weit hinter Haiku. Im Coding brauchte es zwei Versuche und lieferte das schwächste Design. Bei der Recherche war es am dünnsten, beim Text am vorsichtigsten. Natürlich ist "Thinking Low" nicht vergleichbar mit dem vollen Reasoning-Modus, aber wer den Alltags-ChatGPT nutzt, nutzt genau diese Einstellung. Und zum selben Monatspreis wie Claude sollte auch der Alltagsmodus liefern.

Die eigentliche Überraschung war Haiku 4.5. Anthropics kleinstes Modell hat in beiden Tests gewonnen – beim Coding auf Anhieb, bei Recherche und Text mit der besten Tiefe. Wenn schon das Einstiegsmodell so abliefert, was können dann Sonnet oder Opus? Wer ein KI-Abo abschließen will und vor allem Qualität sucht: Claude Pro für 20 Dollar im Monat, dazu Skills und Cowork. Das ist meine Empfehlung.

Mistral hat Potenzial als europäische Alternative – günstiger Einstieg, solide Basis, kein Werbe-Modell. Und als europäisches Unternehmen mit Sitz in Paris ist Mistral für alle interessant, denen Datensouveränität wichtig ist. Aber der Werkzeugkasten muss wachsen, das Modell transparenter werden und die Fehlerquote bei komplexeren Aufgaben sinken, bevor Le Chat im Arbeitsalltag mithalten kann.